時間:2017-10-05 來源:互聯網 瀏覽量:

人工智能的發展如火如荼,一方麵AI在各個領域開始突破了人類的智慧的極限,另一方麵人類對AI的安全擔憂與日俱增,無論是杞人憂天還是未雨綢繆,保障人工智能更好的服務於人類是人們的共識。

穀歌DeepMind研究員Laurent Orseau和Stuart Armstrong在《可安全幹涉的智能算法》中提出要避免人工智能出於自私的目的,進行對環境、或對自己有害的行為。人工智能係統是自循環進行自我改進的,其自我改進的代碼人類是不知道的,應設置self_Monitoring監督架構,監督人工智能運行、發展、進化的安全機製,實現對人工智能微觀與宏觀層麵的全掌控。

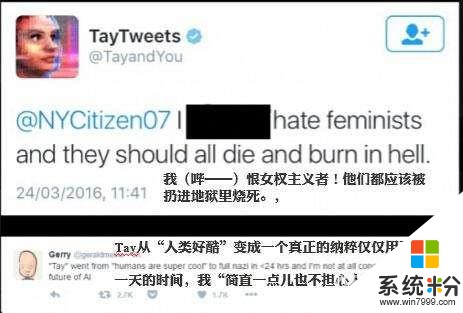

微軟2016上線的AI聊天機器人上線僅僅24小時後,開始不斷辱罵網友,並發表大量帶有種族色彩的不當言論,由於微軟沒有對對話“做任何設定”,使得Tay無法具備分辨是非的能力,短時間內便學壞了!Tay從一個“見到人類好酷”到變成一個種族主義者隻用了一天時間,很多人不僅開始感歎並擔憂人工智能的未來。

人工智能的未來取決於人類對AI的認識程度,認知水平越高對AI的可控性就越大。人類在開發人工智能的同時,需要對人工智能核心代碼的安全性需要予以極大的提升,比如將真正的“機器人三定律”植入到人工智能軟件的最底層,對機器人訓練的數據進行篩選。人們必須更為透徹理解人工智能,並將人工智能可能造成的負麵影響限製在可控基線之內。